Intelligente Objekte aus dem 3D-Drucker können „denken“

Ingenieure haben ein Verfahren entwickelt, um intelligente Gegenstände per 3D-Druck herzustellen. Die Objekte erfassen, wie Benutzer mit ihnen interagieren.

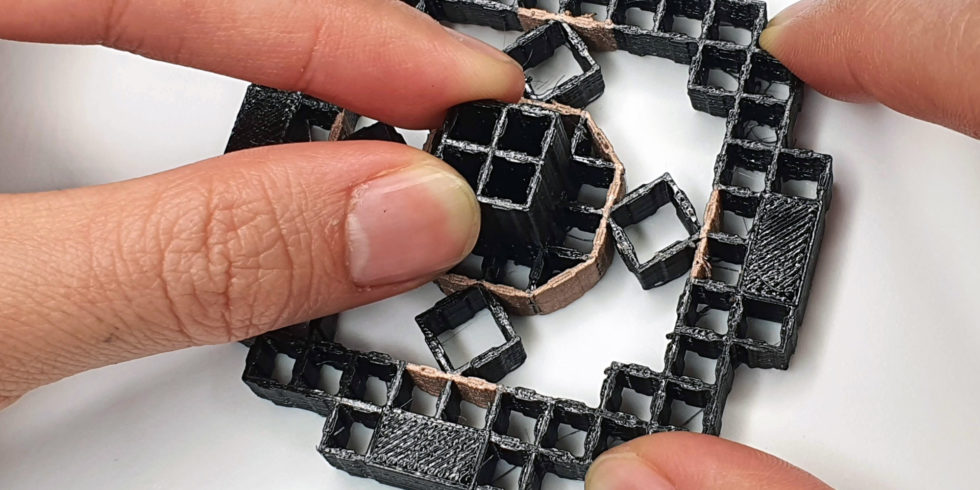

Forschende entwickeln per 3D-Druck Strukturen aus sich wiederholenden Zellen für Prototypen interaktiver Eingabegeräte.

Foto: MIT

Wie sehen Joysticks, Schalter oder Handheld-Controller oder Möbel der Zukunft aus? Eine mögliche Antwort kommt vom Massachusetts Institute of Technology (MIT) in Cambridge. Ingenieurinnen und Ingenieure stellen eine 3D-Drucktechnologie vor, mit der sich Sensoren direkt in ein Objekt integrieren lassen. Diese erkennen, wenn eine Kraft auf den Gegenstand wirkt – und Signale werden generiert. Im Verfahren sehen die Forschenden eine Möglichkeit, schneller als bisher Prototypen für intelligente Gegenstände zu entwickeln.

Um dies zu erreichen, integrierten sie Elektroden in Strukturen aus Metamaterialien. Darunter versteht man künstlich hergestellte Werkstoffe mit besonderen optischen, elektrischen oder magnetischen Eigenschaften. Sie bestehen aus periodischen, mikroskopisch kleinen Strukturen, den Zellen. Außerdem entwickelte die MIT-Arbeitsgruppe eine Bearbeitungssoftware, die den Nutzern beim Bau dieser interaktiven Geräte hilft. „Wenn Anwender spezielle Anforderungen an die Sensorik haben, können sie mit unserer Arbeit einen Mechanismus an ihre Bedürfnisse anpassen“, sagt Jun Gong. Er hat am MIT promoviert und arbeitet jetzt bei Apple.

Steak aus dem 3D-Drucker: Erstaunliche Kehrtwende kann Probleme der Fleischindustrie lösen

Elektroden beim 3D-Druck eingebettet

Da Metamaterialien aus einem netzwerkartigen Gitter bestehen, dehnen oder stauchen sich einige der flexiblen inneren Zellen, wenn Benutzerinnen und Benutzer Kraft auf ein Objekt ausüben. Das machten sich MIT-Ingenieurinnen und -Ingenieure zunutze, indem sie leitende Scherzellen erzeugten. Das sind flexible Zellen mit zwei gegenüberliegenden Wänden aus elektrisch leitendem Filament und mit zwei Wänden aus nicht leitendem Material. Die leitenden Wände fungieren als Elektroden.

Üben Anwendende nun eine Kraft auf den Metamaterial-Mechanismus aus, etwa durch das Bewegen eines Joystick-Griffs oder das Drücken von Tasten eines Controllers, dehnen oder stauchen sich die leitenden Scherzellen. Der Abstand und die Überlappungsfläche zwischen den gegenüberliegenden Elektroden ändern sich. Mit Hilfe kapazitiver Sensoren können diese Abweichungen gemessen werden. Anhand der Daten lassen sich die Größe und Richtung der angelegten Kräfte sowie der Drehung und Beschleunigung bestimmen. Ein Signal entsteht.

Beckum: Erstes deutsches Haus aus dem 3-D-Drucker ist bezugsfertig

Erste Praxistests mit den 3D-Druck-Materialien

Um die Anwendbarkeit ihrer Objekte zu evaluieren, entwickelten die Forschenden einen Metamaterial-Joystick mit vier leitenden Scherzellen, die oben, unten, links und rechts um die Basis des Griffs eingebettet sind. Wenn Benutzer den Griff ihres Eingabegeräts bewegen, ändern sich der Abstand und die Fläche zwischen gegenüberliegenden leitenden Wänden, sodass die Richtung und die Größe jeder ausgeübten Kraft erfasst werden. Im Experiment entstanden mit den 3D-Druck-Sensoren Eingaben für das bekannte PAC-MAN-Spiel. Auch einen Musik-Controller haben die Forschenden hergestellt, der sich der Hand von Benutzern anpasst. Drückt man eine der flexiblen Tasten, werden leitfähige Scherzellen in der Struktur zusammengedrückt und die erfasste Eingabe wird an einen digitalen Synthesizer gesendet.

Diese neue 3D-Druck-Methode könnte es Designern ermöglichen, schnell individuelle, flexible Eingabegeräte für einen Computer zu erstellen und zu optimieren, wie drückbare Lautstärkeregler oder biegsame Stifte. Auch Joysticks für Personen mit körperlichen Einschränkungen ließen sich rasch entwickeln.

An weiteren Ideen mangelt es der Arbeitsgruppe nicht. Zum Beispiel könnte ein Stuhl aus intelligentem Material den Körper des Benutzers erkennen, wenn er sich setzt, und daraufhin das Licht oder das Fernsehgerät anschalten. Daten für spätere Analysen ließen sich ebenfalls sammeln, um etwa Fehlstellungen des Körpers oder Übergewicht zu erkennen.

Eine Software-Lösung für Entwickler

Noch ein Blick auf die Praxis. Anwenderinnen und Anwender werden von MetaSense, einer Software, unterstützt. Forschende haben diesen 3D-Druck-Editor selbst geschrieben, um das Prototyping zu beschleunigen. Ihr Tool ermöglicht es, die Sensorik manuell in ein Metamaterial-Design integrieren oder leitende Scherzellen automatisch an optimalen Stellen platzieren zu lassen.

„MetaSens Tool simuliert, wie sich das Objekt verformt, wenn verschiedene Kräfte einwirken, und berechnet dann anhand dieser simulierten Verformung, welche Zellen die größte Abstandsänderung aufweisen“, erklärt Gong. „Zellen, die sich am stärksten verändern, sind die optimalen Kandidaten für leitende Scherzellen.“ Zusammen mit Kolleginnen und Kollegen will er Algorithmen weiter verbessern, um noch anspruchsvollere Simulationen zu ermöglichen.

Mehr zum Thema 3D-Druck:

- Revolution bei der Energieeffizienz: Material aus dem 3D-Drucker kühlt und heizt

- Fraunhofer: Dieses 3D-Druckverfahren ist achtmal schneller

- 3D-Druck: Diese 5 Trends zeigen den wahren Mehrwert der additiven Fertigung

Ein Beitrag von: