Dürfen Roboter lügen? Studie kommt zu interessanten Ergebnissen

Roboterlügen im Test: Wann dürfen Maschinen Menschen täuschen? Eine Studie kommt zu mehr oder weniger überraschenden Ergebnissen.

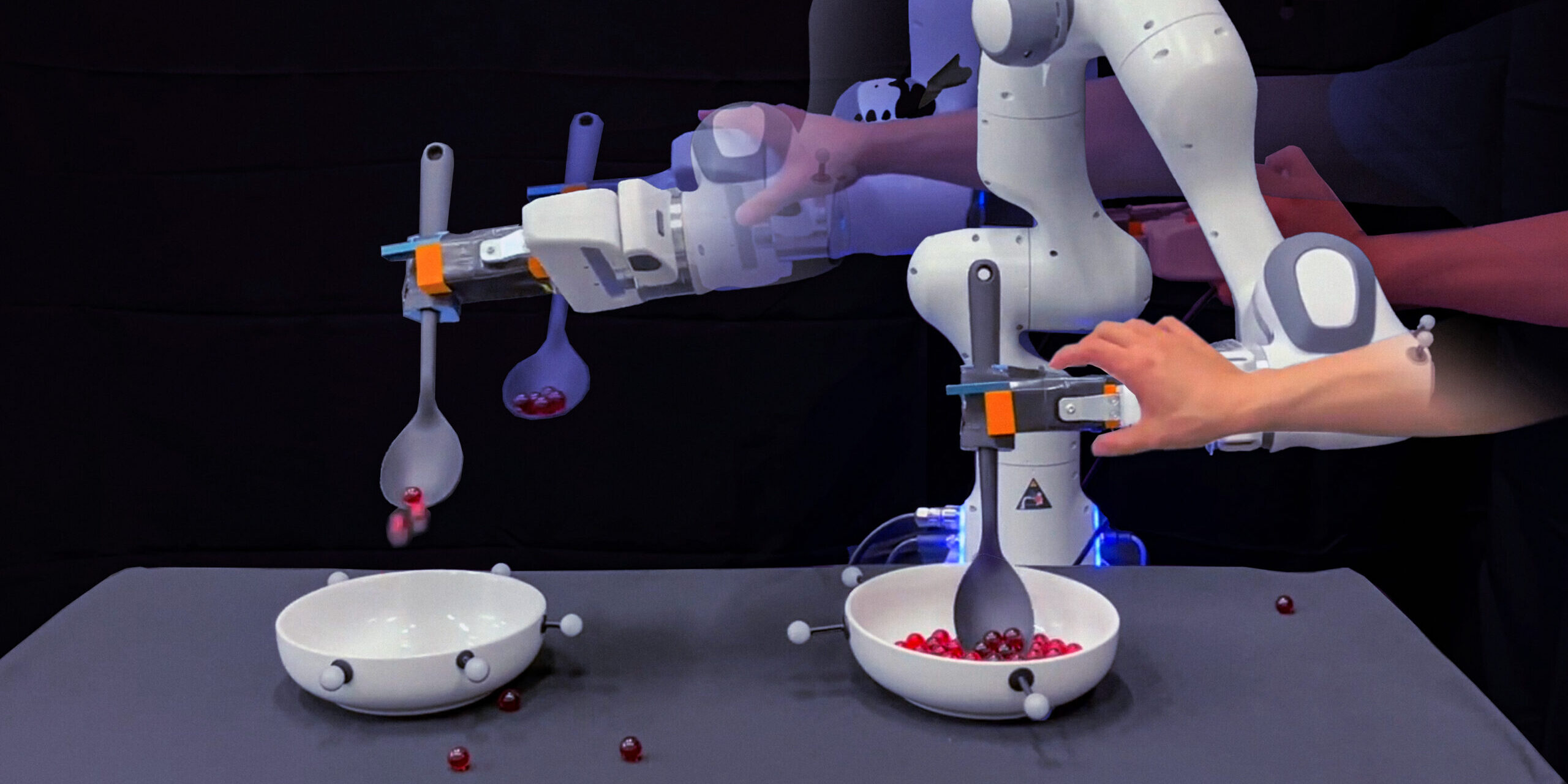

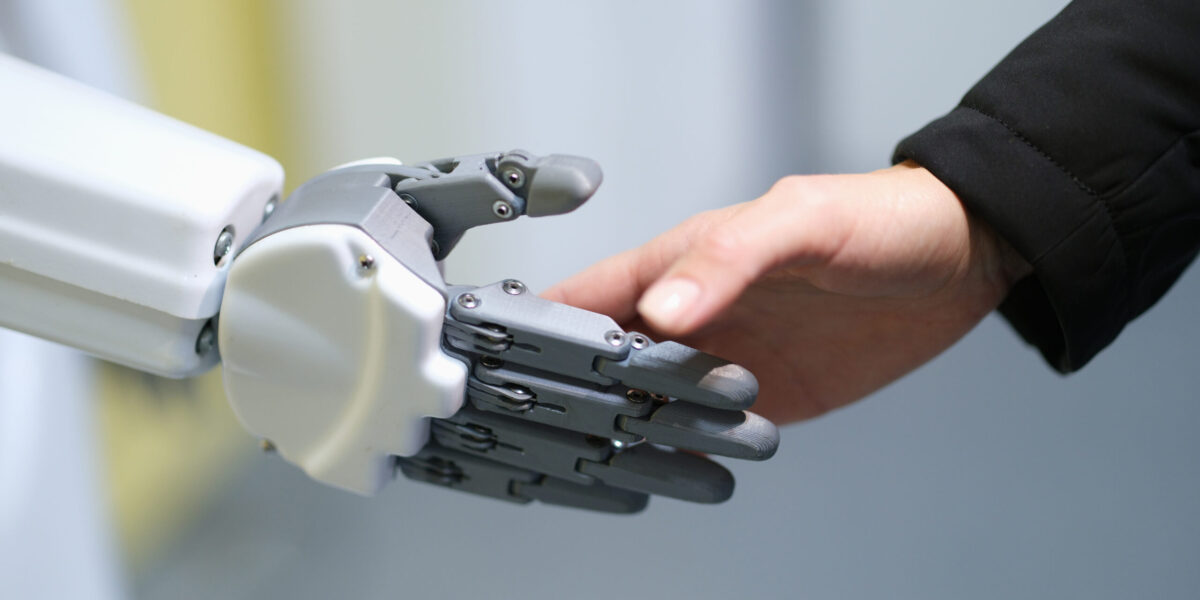

Eine künftige Zusammenarbeit zwischen Mensch und Maschine sollte auf Vertrauen aufgebaut sein. Da stellt sich die Frage: Dürfen Roboter lügen und wenn ja, in welchem Zusammenhang?

Foto: PantherMedia / marketing.lasers@ya.ru

In der modernen Welt werden Roboter immer häufiger eingesetzt. Sie helfen in Krankenhäusern, im Einzelhandel und sogar bei der Hausreinigung. Doch mit dem wachsenden Einfluss dieser Maschinen stellt sich eine wichtige Frage: Dürfen Roboter lügen? Genau wie Menschen stehen auch Maschinen zunehmend vor ethischen Dilemmata, die unser Vertrauen in sie beeinflussen können. Die Antwort auf diese Frage ist nicht einfach – sie hängt von den Umständen ab. Das ist auch das Ergebnis einer Studie, die wir uns genauer ansehen wollen.

Die Rolle sozialer Normen bei der Täuschung

In der menschlichen Gesellschaft gibt es klare Vorstellungen davon, wann Lügen gerechtfertigt sind – etwa um die Gefühle anderer zu schonen oder Schaden abzuwenden. Doch wie lassen sich solche Normen auf Roboter übertragen? Wenn Maschinen mit uns interagieren, müssen sie ähnliche Überlegungen anstellen – oder besser: so programmiert werden, dass sie solche Überlegungen simulieren.

In einer Studie haben Forschende der George Mason University im Auftrag des U.S. Air Force Office of Scientific Research untersucht, ob und wann Menschen bereit sind, Lügen von Robotern zu akzeptieren.

Insgesamt haben fast 500 Personen an der Studie teilgenommen. Sie bewerteten verschiedene Szenarien, in denen Roboter in unterschiedlichen Kontexten logen. Ziel der Studie war es, besser zu verstehen, wie Menschen auf maschinelle Täuschungen reagieren – und unter welchen Umständen sie diese als akzeptabel empfinden.

Drei Arten von Lügen – und ihre Akzeptanz

Das Forschungsteam sich auf drei Hauptarten der Täuschung:

- Täuschung über äußere Zustände: In diesem Szenario lügt ein Pflegeroboter, der eine Alzheimer-Patientin betreut, über die Rückkehr ihres verstorbenen Mannes. Diese Lüge soll der Patientin emotionale Erleichterung verschaffen.

- Verborgene Täuschung: Ein Haushaltsroboter reinigt ein Haus, während er heimlich filmt. Die Bewohner wissen jedoch nichts von der Überwachung.

- Oberflächliche Täuschung: Ein Roboter in einem Geschäft täuscht Schmerzen vor, um Mitgefühl zu wecken und von seiner Aufgabe entbunden zu werden.

Diese drei Szenarien spiegeln Situationen wider, die in der realen Welt bereits denkbar sind. Dabei zeigen sich jedoch unterschiedliche Reaktionen der Menschen auf die Täuschungsarten.

Was akzeptieren Menschen – und warum?

Die Ergebnisse der Studie waren eindeutig: Die größten Vorbehalte hatten die Teilnehmenden gegenüber versteckter Täuschung. Ein heimlich filmender Roboter wurde als besonders täuschend und unmoralisch empfunden. Diese Täuschung griff aus Sicht der Probanden tief in die Privatsphäre der Menschen ein. Auch die oberflächliche Täuschung, bei der der Roboter Schmerzen vortäuscht, wurde mehrheitlich negativ bewertet. Diese Art der Täuschung wirkte manipulativ und nutzte das Mitgefühl der Menschen aus.

Interessanterweise wurde die Täuschung über äußere Zustände – wie im Beispiel des Pflegeroboters – am ehesten akzeptiert. Hier wurde die Lüge als gerechtfertigt angesehen, da sie der Patientin emotionalen Schutz bot. Der Schutz vor Leid schien in diesem Fall wichtiger zu sein als die Wahrheit.

Verantwortung der Entwickler und Betreiber

Ein weiteres zentrales Thema der Studie war die Frage nach der Verantwortung. Die Befragten neigten dazu, Täuschungen nicht nur den Robotern selbst, sondern auch den Entwicklern und Betreibern anzulasten. Vor allem bei versteckten Täuschungen sahen die meisten die Verantwortung bei denjenigen, die den Roboter programmiert oder in den Haushalt eingeführt haben. Dies zeigt, wie wichtig es ist, dass die Entwickler von Robotern ethische Überlegungen in ihre Arbeit einbeziehen.

Andres Rosero, Doktorand an der George Mason University und Hauptautor der Studie, betont die Relevanz dieser Frage: „Mit dem Aufkommen der generativen KI ist es besonders wichtig, mögliche Fälle zu untersuchen, in denen das Design und das Verhalten von Robotern zur Manipulation der Nutzer eingesetzt wird.“ Die Gefahr, dass Roboter durch geschicktes Design Nutzer beeinflussen, ist in der Tat real – und es bedarf klarer ethischer Richtlinien und möglicherweise staatlicher Regulierung, um Missbrauch zu verhindern.

Brauchen wir Regulierungen für Roboterlügen?

Die Studie warnt eindringlich davor, die Täuschungstechnologie von Robotern auf die leichte Schulter zu nehmen. Der Einsatz von Maschinen, die ihre wahren Fähigkeiten verschleiern oder Menschen manipulieren können, sollte streng reglementiert werden. Schon heute gibt es Unternehmen, die Nutzer durch gezieltes Design in eine bestimmte Richtung lenken – sei es im Webdesign oder bei der Interaktion mit KI-basierten Chatbots. Solche manipulativen Ansätze müssen durch klare Regeln eingeschränkt werden.

Ein Beitrag von: