Siemens schickt digitale Agenten in Engineering und Produktion

Je mehr Informationen in der Produktentwicklung und der Produktion gesammelt und mit künstlicher Intelligenz generiert werden, desto wichtiger werden digitale Agenten. Wie die arbeiten, zeigt dieses Beispiel von Siemens.

Mit seinem Industrial Copilot bringt Siemens künstliche Intelligenz über Agentensysteme in Produktion und Entwicklung. Verschiedene Informationsquellen werden dazu von den digitalen Agenten nach den gesuchten Informationen durchforstet.

Foto: Siemens AG

Generative KI und Grundmodelle (Foundation Models) sicher in den Fabrikalltag zu bringen, hat sich Siemens zum Ziel gesetzt. Dazu arbeitet der Konzern aus München unter anderem mit Microsoft zusammen. Analog zum KI-unterstützten Assistenzsystem Copilot von Microsoft für die Bürosoftware hat Siemens Ende 2023 erstmals seinen Industrial Copilot vorgestellt. Nun wird deutlich, in welche Richtung die Entwicklung gehen soll.

„Hallo Maschine, wie geht es Dir?“ Mit diesen Worten machte Siemens anfangs Werbung für den Einsatz künstlicher Intelligenz (KI) in der Fabrikhalle. Was zunächst nach einem einfachen Chatbot klingt, wird durch Agentensysteme jetzt aber deutlich erweitert. Generative KI wie ChatGPT zur Erkennung und Analyse von Textinformationen ist dabei nur ein Element, das durch sogenannte Agenten um zahlreiche weitere Kompetenzen ergänzt wird.

Für Rainer Brehm, den CEO Factory Automation bei Siemens Digital Industries, sind Agentensysteme die Zukunft. Solche industriellen KI-Agenten handeln untereinander Parameter für Regelkreise aus, ohne dass dafür eine zentrale Steuerung nötig ist. Sie folgen dabei aber vorgegebenen Regeln. Bei Entwicklungen im Rahmen der Plattform Industrie 4.0 spielen sie deshalb seit jeher eine zentrale Rolle. „KI-Agenten sind der Industrie-4.0-Booster schlechthin. Unsere Vision ist es, mit diesen intelligenten und autonomen Assistenten Menschen in der Produktion und im Engineering die Arbeit zu erleichtern“, verdeutlich Brehm die Siemens-Sicht.

Das Team von Siemens bei der Übergabe des Hermes Award durch Forschungsminister Cem Özdemir im Rahmen der Hannover Messe

Foto: Martin Ciupek

So arbeiten Agentensysteme und KI in der Industrie zusammen

Wie solche Agenten im Zusammenhang mit KI arbeiten, lässt sich bei den Lösungen von Siemens gut erkennen. Basis dafür ist das „Industrial-Edge-Ökosystem“ des Unternehmens. Das umfasst eine Plattform für industrielles Edge-Computing sowie ein zentrales App- und Gerätemanagement mit einer Vielzahl von Anwendungsprogrammen und Geräten. Teil des Ökosystems sind inzwischen auch KI-Komponenten sowie der Siemens Industrial Copilot. Damit kann generative künstliche Intelligenz direkt an den Maschinen bzw. auf der Fabrikebene eingesetzt werden.

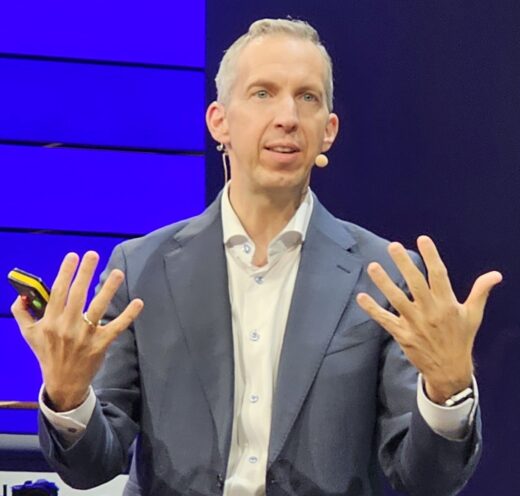

„Generative KI ist für uns ein enormer Produktivitätshebel“, sagt Rainer Brehm, CEO Factory Automation des Siemens-Geschäftsbereichs Digital Industrie.

Foto: M. Ciupek

Das funktioniert so: Die Agenten bilden ein Ensemble, das von zentraler Stelle zunächst orchestriert werden muss. Der sogenannte Orchestrator-Agent kennt die Fähigkeiten aller seiner Agenten. Auf dieser Softwareebene werden die Agenten verwaltet und je nach Aufgabe aktiviert oder deaktiviert. Über die Benutzerschnittstelle entscheidet dabei der Anwender, welche Agenten bzw. Fähigkeiten eingesetzt werden sollen und welche nicht.

Digitale Agenten in der Batteriezellenproduktion

Den Ablauf verdeutlicht ein Anwendungsfall, den Siemens zusammen mit ThyssenKrupp Automation Engineering für ein Modul in der Batteriezellenfertigung realisiert hat. Es ging darum, eine Lösung zu finden, wenn LED-Lichter in der Anlage nicht richtig leuchten. Manchmal liegt das in der Praxis daran, dass diese falsch ausgelegt wurden und deshalb zu wenig Energie bekommen. Das gilt es mithilfe generativer KI herauszufinden.

Die Anfrage an den Industrial Copilot lautet in dem Fall sinngemäß: „Die LED-Lichter funktionieren in der Station an der Stelle xy nicht. Weißt du, woran das liegt?“ Der Bediener braucht dazu kein weiteres Wissen über die Anlage. Der Orchestrator-Agent erstellt darauf hin zunächst einen Plan, wie er vorgehen würde.

In einer automatisierten Anlage zur Qualitätssicherung in der Batteriezellenproduktion setzt Thyssenkrupp Automation Engineering den Industrial Copilot von Siemens ein. Beispielsweise können damit Bilder von Inspektionskameras intuitiv abgefragt werden.

Foto: thyssenkrupp Automation Engineering

Zum Beispiel würde er zunächst auf der Engineering-Plattform (TIA Portal) nachschauen, weil dort alle Daten zur Auslegung hinterlegt sind. Dann würde er sich relevante Daten in Excel-Tabellen, Stücklisten und Servicedokumentationen ansehen. Abschließend würde er daraus mögliche Fehlerquellen extrahieren und Vorschläge machen. Bevor das System jedoch aktiv wird, fragt es über den Copiloten noch einmal nach: „Soll ich das so machen?“

Der Engineering-Agent sammelt Informationen, doch der Mensch entscheidet

Jeder Schritt wird dazu auf dem Bildschirm visualisiert und vom Bediener einzeln bestätigt oder abgelehnt. Erst dann legen die digitalen Agenten los. Sie ziehen die benötigten Informationen aus dem TIA Portal, suchen zusätzliche Informationen im Firmennetz und/oder dem Internet. Das können auch Informationen sein, die ein Kunde oder Partner zur Verfügung stellt. Im nächsten Schritt schaut sich dann ein Datenanalyst-Agent die gesammelten Informationen an und sucht nach der Ursache des Problems.

Der Agent schaut sich dazu die jeweilige Wissensdatenbank an, die vom TIA Portal und die von anderen Quellen. Experten sprechen auch von „Knowledge-Graphen“, denn darin sind nicht nur Informationen abgelegt. Die Knowledge-Graphen bestehen aus Knoten und Kanten, die Entitäten und Beziehungen zwischen diesen repräsentieren. Stößt der Agent bei der Analyse auf Ergebnisse, die nicht übereinstimmen (mismatch), setzt der Orchestrator-Agent dort an.

Im Beispiel kommt zu wenig Strom an der LED an. Das System macht daher Vorschläge, wie der Fehler behoben werden kann. Der Bediener wird dabei vom Copilot Schritt für Schritt durch die jeweiligen Optionen geführt. Konkret kann das in dem Fall heißen: Der Agent schlägt vor, die Hardware auszutauschen. Das wird dann zunächst in der Engineering-Plattform TIA Portal geändert. Ist die LED-Komponente erfolgreich ersetzt und die Funktionsfähigkeit erfolgreich überprüft, wird die Änderung im nächsten Schritt auch im PDF-Dokument des Schaltplans eingepflegt. Das passiert zudem überall dort, wo es zur Dokumentation noch notwendig ist. Am Ende kann ein weiterer Agent z. B. eine E-Mail mit dem Sachverhalt an den zuständigen Elektroingenieur schicken.

Das funktioniert noch besser, wenn auch die externen Lösungen in das Industrial-Edge-Ökosystem eingebunden sind. Denn dann werden die Änderungen automatisch z. B. in Eplan oder andere Programme eingepflegt.

Zur Rolle der künstlichen Intelligenz in dem Prozess sagt Siemens-CEO Brehm: „Generative KI ist für uns ein enormer Produktivitätshebel. Mithilfe des Industrial Copilots können wir Maschinen schneller entwickeln, Automatisierungscodes generieren und Fehlerquellen identifizieren und beheben.“

Agenten sammeln Informationen für Maschinenbediener

Ähnlich funktioniert auch das Zusammenspiel des Copiloten mit dem Orchestrator, wenn der Anlagenbediener nach konkreten Informationen sucht. Das können z. B. die letzten zehn Nicht-Okay-Bilder aus dem Bildverarbeitungssystem für die Batteriezelleninspektion sein. Dann beschafft ein digitaler Agent diese aus der entsprechenden Datenbank und sie werden anschließend über das Bediendisplay angezeigt. Steht ein Komponentenwechsel an, kann der Copilot beispielsweise gebeten werden, die Komponenten im Anlagenplan zu identifizieren und auf dem Display anzuzeigen. Auch dafür werden entsprechende Agenten eingesetzt.

Es geht also längst nicht nur um die Verarbeitung textueller Informationen wie bei ChatGPT. Das System braucht vom Anwender lediglich eine konkrete Anforderung als Input, dann werden die nötigen Texte, Bilder und Sensordaten durchsucht.

Ein Beitrag von: