Roboter beobachten sich selbst – und lernen dabei

Forschende haben eine Methode entdeckt, bei der Roboter durch Kameraeinsatz ihre eigene Körperstruktur verstehen lernen. Dies ermöglicht es den Maschinen, Beschädigungen selbstständig zu kompensieren und ihre Bewegungen anzupassen – ein entscheidender Schritt für mehr Autonomie und Zuverlässigkeit in verschiedenen Einsatzgebieten.

Lernende Roboter versprechen mehr Autonomie und Zuverlässigkeit.

Foto: PantherMedia / Mihajlo Maricic

Eine Forschungsgruppe der Columbia University School of Engineering and Applied Science präsentiert eine neue Entdeckung in der Robotik: Roboter, die ihre eigenen Bewegungsmuster mittels Kameratechnik beobachten, können ein Verständnis für ihren Körperaufbau entwickeln. Dies eröffnet neue Möglichkeiten für die Selbstoptimierung von Maschinen. Statt auf vorprogrammierte Bewegungsabläufe angewiesen zu sein, können Roboter nun eigenständig lernen, wie sie sich effizient fortbewegen und ihre Aktionen planen. Bemerkenswert ist dabei ihre Fähigkeit, Beeinträchtigungen ihrer Funktionalität zu erkennen und Bewegungsmuster entsprechend anzupassen, was ihre Einsatzfähigkeit deutlich verbessert und verlängert.

Yuhang Hu, Doktorand am Creative Machines Lab der Columbia University, vergleicht diesen Lernprozess mit menschlichem Verhalten: „Wie Menschen, die tanzen lernen, indem sie ihr Spiegelbild betrachten, nutzen Roboter jetzt Rohvideos, um ein kinematisches Selbstbewusstsein aufzubauen.“ Der Nachwuchswissenschaftler arbeitet unter der Leitung von Professor Hod Lipson und betont: „Unser Ziel ist ein Roboter, der seinen eigenen Körper versteht, sich an Schäden anpasst und neue Fähigkeiten erlernt, ohne dass er ständig von Menschen programmiert werden muss.“

Selbstlernende Roboter beeinflussen Entwicklungsprozesse

Traditionell durchlaufen Roboter zunächst virtuelle Trainingsphasen in Simulationsumgebungen, bevor sie zum Einsatz kommen. Professor Lipson erklärt die Herausforderungen dabei: „Je besser und realistischer der Simulator ist, desto einfacher ist es für den Roboter, den Sprung von der Simulation in die Realität zu schaffen.“ Präzise Simulatoren zu entwickeln erfordert jedoch hochqualifizierte Fachkräfte und bedeutet einen erheblichen Zeitaufwand. Die neue Methode umgeht dies, indem der Roboter selbst zum Entwickler seiner eigenen Simulationsumgebung wird. Durch kontinuierliche Selbstbeobachtung kann er sein virtuelles Modell ständig aktualisieren und an Veränderungen anpassen. Das spart Entwicklungsressourcen und steigert die Anpassungsfähigkeit der Maschine.

Die Forschenden haben einen Durchbruch erzielt, indem sie Robotern beibrachten, ihre dreidimensionale Form mit einer gewöhnlichen 2D-Kamera zu erfassen. Diese Technik basiert auf drei verschiedenen KI-Systemen, die nach dem Vorbild des menschlichen Gehirns als tiefe neuronale Netze konzipiert sind. Diese Netzwerke können aus zweidimensionalen Videoaufnahmen dreidimensionale Bewegungsmuster ableiten. Bemerkenswert ist die Fähigkeit des Systems, Veränderungen am Roboter zu erkennen und Bewegungsabläufe anzupassen.

Alltagstaugliche Roboter dank fortschrittlicher Selbstwahrnehmung

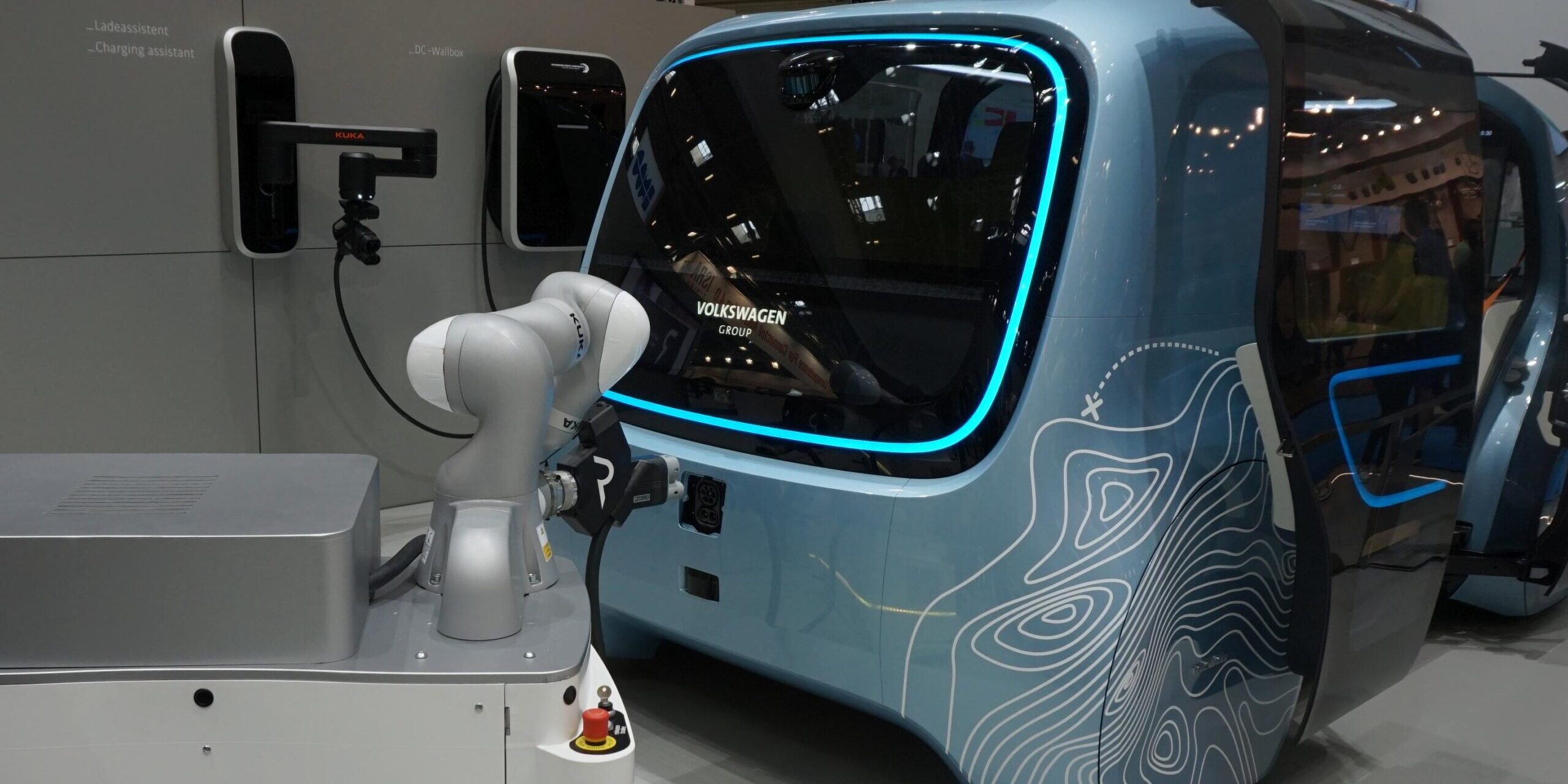

Die praktischen Anwendungsmöglichkeiten dieser Technologie sind vielfältig und könnten unseren Alltag revolutionieren. Yuhang Hu veranschaulicht dies mit einem alltagsnahen Beispiel: „Stellen Sie sich beispielsweise einen Staubsaugerroboter oder einen persönlichen Assistenzroboter vor, der feststellt, dass sein Arm nach einem Zusammenstoß mit einem Möbelstück verbogen ist. Anstatt auszufallen oder repariert werden zu müssen, beobachtet er sich selbst, passt seine Bewegungen an und arbeitet weiter. Dadurch könnten Heimroboter zuverlässiger werden – eine ständige Neuprogrammierung wäre nicht mehr erforderlich.“

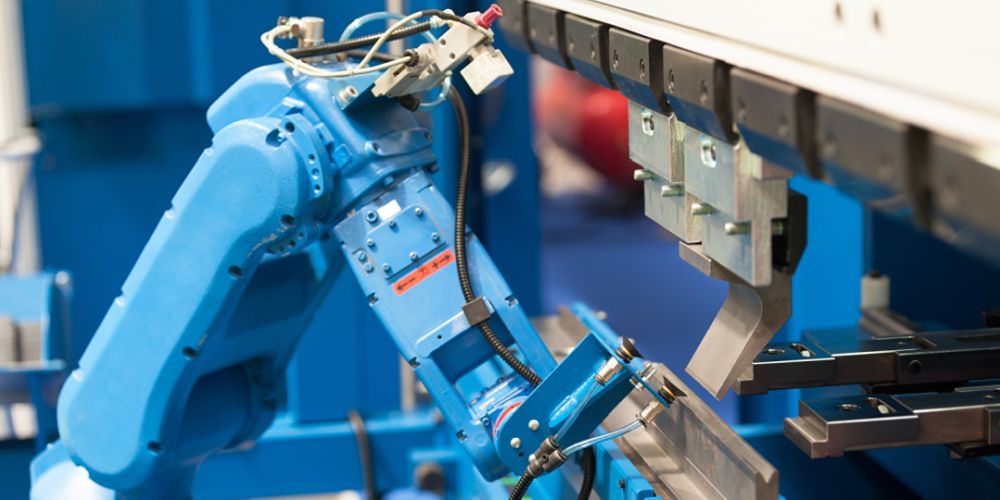

Auch in industriellen Umgebungen bietet diese Technologie Vorteile. Ein Roboterarm in einer Autofabrik könnte dank dieser Selbstwahrnehmung seine Bewegungen eigenständig korrigieren und dann weiterproduzieren. Hu erläutert: „Anstatt die Produktion anzuhalten, könnte er sich selbst überwachen, seine Bewegungen anpassen und wieder mit dem Schweißen beginnen – das würde Ausfallzeiten und Kosten reduzieren. Diese Anpassungsfähigkeit könnte die Fertigung widerstandsfähiger machen.“

Die Evolution der Roboter-Selbstwahrnehmung

Professor Lipson betont die wachsende Bedeutung autonomer Systeme in unserer Gesellschaft: „Roboter müssen lernen, für sich selbst zu sorgen, wenn sie wirklich nützlich werden sollen. Deshalb ist die Selbstmodellierung so wichtig.“ Die aktuelle Studie stellt den vorläufigen Höhepunkt einer langjährigen Forschungsreihe dar, die das Columbia-Team über zwei Jahrzehnte hinweg vorangetrieben hat. Die Entwicklung begann 2006 mit Robotern, die strichmännchenartige Selbstmodelle erstellen konnten. Etwa zehn Jahre später gelang es den Forschenden, mithilfe mehrerer Kameras präzisere Modelle zu generieren.

Der jüngste Durchbruch ermöglicht es einem Roboter nun, ein umfassendes kinematisches Selbstmodell zu erstellen, bezeichnet als „Kinematische Selbstwahrnehmung“. Professor Lipson zieht eine Parallele zwischen menschlicher und maschineller Selbstwahrnehmung: „Wir Menschen sind uns unseres Körpers intuitiv bewusst; wir können uns selbst in der Zukunft vorstellen und die Folgen unserer Handlungen visualisieren, lange bevor wir diese Handlungen in der Realität ausführen. Wir möchten Roboter mit einer ähnlichen Fähigkeit ausstatten.“

Ein Beitrag von: