Immer wieder Unfälle mit autonomen Autos

Jeder Unfall mit einem autonomen Fahrzeug wirft Fragen auf: Wer trägt die Schuld? Wie sicher sind technische Systeme? Kommen die Hersteller ihrer Verantwortung nach? Und wofür braucht es überhaupt autonome Autos? Wir haben uns auf die Suche nach Antworten gemacht.

Foto: Uber Technologies Inc. (Symbolbild)

Immer mehr Unternehmen testen selbstfahrende Fahrzeuge. Bekannte Hersteller wie Tesla, Mercedes, Volvo und BMW arbeiten an verschiedenen Testprojekten. Doch so ganz rund scheint es noch nicht zu laufen mit dem Versprechen, dass autonome Fahrzeuge den Verkehr sicherer machen sollen. Immer wieder gibt es Meldungen über Unfälle, in die die Autos ohne Fahrer verwickelt sind. Laut den Entwicklern gehen allerdings rund 90 % davon auf menschliche Fehler zurück. Bei einem aktuellen Unfall mit Todesfolge sieht es auf den ersten Blick anders aus.

Robotertaxi von Uber verursacht tödlichen Unfall

Im März 2018 ereignete sich in der US-amerikanischen Stadt Tempe im Bundesstaat Arizona ein tödlicher Unfall. Ein autonomes Fahrzeug vom Dienstleister Uber fuhr bei Dunkelheit und erwischte eine 49-jährige Frau. Diese schob ihr Fahrrad außerhalb eines Fußgängerübergangs über die Straße und wurde von dem autonomen Fahrzeug erfasst. Die Frau wurde zwar umgehend ins nächste Krankenhaus gebracht, erlag dort aber ihren Verletzungen.

Die Folge: Uber darf in Arizona nicht weiter an seinen Roboterautos testen, der Gouverneur sprach am Dienstag ein Verbot aus.

Deutsche Professoren wundern sich über den Uber-Unfall

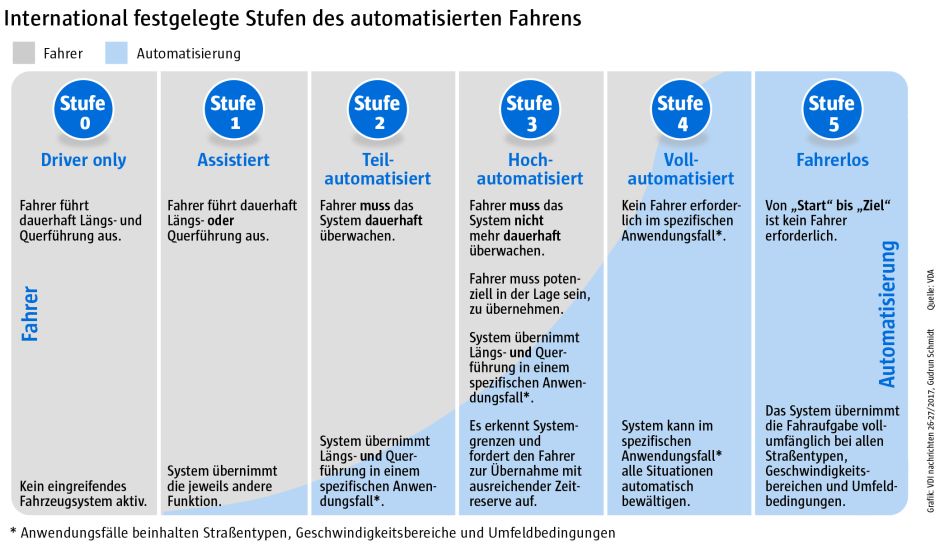

Die Professoren Klaus Bengler, Klaus Dietmayer, Lutz Eckstein, Markus Maurer, Christoph Stiller und Hermann Winner haben sich den Unfallhergang genauer angesehen. Sie weisen darauf hin, dass das Uber-Fahrzeug als teilautomatisiert gelten muss. Nach dieser international festgelegten Stufe 2 des automatisierten Fahrens, muss der Fahrer das System dauerhaft überwachen und im Zweifelsfall eingreifen. Da dies den Polizeiaussagen und der Videos zufolge, die mittlerweile im Netz kursieren, nicht passiert ist, fordern die Professoren die Behörden auf, zu prüfen, „wie Sicherheitsfahrer durch Uber ausgebildet werden und ob das Sicherheitskonzept des Versuchsbetriebs ausreichend war“. Immerhin gebe der aktuelle Stand der Technik ein sicheres Fahren in dieser Situation durchaus her.

Das automatisierte Fahrzeug in Tempe war mit Lidar-, Radar- und Kamerasensoren ausgestattet. Die in der Dunkelheit schlechtesten Ergebnisse dürfte die Kamera aufweisen, die die Fußgängerin eine gute Sekunde vor der Kollision erfasste. Die Lidar- und Radarsensoren dagegen erzielen bei Dunkelheit mindestens dieselben Ergebnisse wie bei Tag. Sie senden zur Entfernungsmessung nämlich aktiv Laserpulse im Infrarotbereich, bzw. Radarstrahlen aus. Die Notbremsfunktion heutiger Fahrzeuge basiert auf eben jenen Sensoren und hätte ein Fahrzeug in der vorliegenden Situation zumindest abgebremst, analysieren die Wissenschaftler. Doch in dem Uber-Fahrzeug war die Notbremsfunktion offensichtlich ausgeschaltet worden. All das veranlasst die sechs Wissenschaftler zu einer schlimmen Vermutung: „Insbesondere Start-Ups in den USA stehen scheinbar, auch durch den Wettlauf um Finanzinvestoren, unter so großem Erfolgszwang, dass sie im Zweifelsfall eher zu früh im öffentlichen Straßenverkehr testen.“ Eine Analyse, die andere Wissenschaftler teilen.

Verkehrsunfälle mit autonomen Fahrzeugen

Es ist leider nicht das erste Mal, dass ein autonomes Fahrzeug an einem Unfall beteiligt ist. Und auch nicht der erste, der tödlich endet. Am 7. Mai 2016 raste ein Tesla S im amerikanischen Williston (Florida) in einen Lkw-Anhänger. Durch den starken Aufprall wurde das Dach des autonomen Fahrzeugs fast komplett abgerissen. Der 40 Jahre alte Fahrer hatte sein Fahrzeug nur zum Teil auf Autopilot gestellt, konnte den Zusammenprall aber nicht mehr verhindern. Er starb noch am Unfallort. Es war der erste tödliche Unfall, der von einem autonom fahrenden Fahrzeug verursacht wurde.

Am 1. Juli 2016 überschlug sich ein SUV-Modell Model X von Tesla im amerikanischen Pennsylvania. Der Fahrzeuginhaber sagte aus, er habe sein Fahrzeug nach der Aktivierung des Autopiloten in eine Leitplanke gelenkt, bevor es dort einen Kopfstand gemacht habe. Laut dem Hersteller Tesla gebe es keine Beweise dafür, dass der Autopilot Schuld an dem Unfall habe. Das Unternehmen reagierte nicht etwa mit dem Rückruf seines Autopiloten, sondern indem es fortan die komplette Hardware für autonomes Fahren in seine Modelle einbaut.

Am 14. Dezember im Jahr 2016 überfuhr ein autonomer Volvo von Uber eine rote Ampel. Der Unfall ereignete sich im US-amerikanischen San Francisco. Das Unternehmen Uber hatte für die Stadt keine Genehmigung. Das Unternehmen war der Ansicht, dass die autonomen Taxis keine bräuchten, solange ein Fahrer dabei sei, der jederzeit eingreifen könne. Infolgedessen analysierte San Francisco die Betriebserlaubnis aller selbstfahrenden Fahrzeuge von Uber und entzog ihnen schließlich die Straßenzulassung.

Anfang März 2017 gab es einen Unfall im US-amerikanischen Tempe. Wie bei dem aktuellen Uber-Unfall war auch an dem ersten Unfall ein autonomes Fahrzeug vom Dienstleister Uber beteiligt. Der Uber-XC90 hatte einem anderen Straßenteilnehmer seine Vorfahrt genommen und verunfallte. Nach dem schweren Unfall lag der Volvo auf der Seite. Mehr passiert ist zum Glück nicht, es wurde niemand verletzt.

Am 1. März 2016 rammte ein Google-Auto einen Linienbus. Es war das erste Mal, dass ein autonomes Fahrzeug von Google einen Unfall verursachte –allerdings stellte sich heraus, dass der Testfahrer die Automatik vorher selbst abgeschaltet hatte. Bei all den vorigen Unfällen von Google-Autos hatte die Automatik ebenfalls keine Schuld, vielmehr waren es staunende Passanten, die auf das langsame Gefährt auffuhren.

Wer war an den Unfällen schuld?

Die Untersuchungen zu dem aktuellen Unfall mit Todesfolge dauern noch an. Laut den Aussagen der zuständigen Polizei ist die Frau jedoch überraschend und aus dem Schatten heraus über die Straße gelaufen und hat keinen offiziellen Übergang benutzt. Weder ein autonomes noch ein manuelles Fahrzeug hätte in dem kurzen Zeitraum ausreichend schnell bremsen oder reagieren können, um den Unfall zu verhindern. Somit sei an dem Unfall im amerikanischen Tempe wohl nicht der autonome Volvo schuld, sondern die Fußgängerin.

An dem Unfall im März 2017 in Tempe war laut Polizei ebenfalls nicht die Technik des selbstfahrenden Fahrzeugs schuld. Beim tödlichen Unfall mit dem Tesla im Mai 2016 sollten laut Aussagen des Herstellers die Sensoren des Fahrzeuges schuld gewesen sein. Die Sensoren des Autopiloten konnten den weiß lackierten Anhänger des Lkw nicht von dem hellen Horizont unterscheiden. Nach weiteren Untersuchungen wies die US-amerikanische Behörde NTSB die ganze Schuld aber dem Fahrer zu. Er war deutlich zu schnell gewesen und hatte seine Hände nicht die ganze Zeit über am Lenkrad. Die Warnungen des Autopiloten ignorierte er mehrfach.

Obwohl es bereits mehrere Unfälle mit selbstfahrenden Fahrzeugen gab, ist die Technik in den meisten Fällen nicht für die Unfälle verantwortlich. Bei den meisten Unfällen liegt menschliches Versagen vor. Dennoch feilen die Fahrzeughersteller weiter an der Technik, denn jeder Unfall zeigt: Die Hersteller müssen die Sensorik ihrer Fahrzeuge noch deutlich verbessern, damit in Zukunft kein Testfahrer mehr die Kontrolle übernehmen muss. Und die Testfahrer müssen die automatisierten Fahrzeuge derweil als das anerkennen, was sie sind, nämlich Testfahrzeuge.

Als drittes müssen die Hersteller selbst ihre Testprojekte überdenken. So gehe Uber in seiner Entwicklung „sehr aggressiv vor“, sagte Wie Raul Rojas, Informatikprofessor an der Freien Universität Berlin, gegenüber Spiegel Online. „Sie (die Firma, Anm. d. Red.) testet nicht besonders lang, sondern schickt die Autos sofort auf die Straße.“ Um keine Menschen zu gefährden, müsse man sich aber Zeit nehmen und ausgiebig testen. „Daran hält sich Uber überhaupt nicht.“

Die Entwicklung autonomer Fahrzeuge geht unbeirrt weiter

Ab April 2018 dürfen in Kalifornien selbstfahrende Fahrzeuge ohne ein Lenkrad oder Pedale am Straßenverkehr teilnehmen. Knapp 50 Unternehmen aus verschiedenen Ländern haben bisher die offizielle Erlaubnis erhalten, auf kalifornischen Straßen ihre autonomen Fahrzeuge zu testen. Ab dem 2. April dürfen Lizenzen für Autos ohne Menschen hinter dem Steuer beantragt werden. Die Fahrzeuge müssen alle aktuellen Sicherheitsstandards erfüllen und gegen Cyberattacken geschützt sein. Der Betrieb soll per Funk überwacht werden und die Autos sollen zu ihren Fahrten alle Daten aufzeichnen. Zusätzlich müssen die Hersteller ein Verfahren entwickeln, damit Polizisten mit einem Roboterauto kommunizieren und es stoppen können.

Ein Beitrag von: