Computer sieht fast wie ein Mensch – Nobelpreisträger helfen ihm dabei

Ein Forscherteam der TU Graz bringt Computern das Sehen bei und orientiert sich dafür am menschlichen Gehirn. Durch die künstliche Intelligenz entsteht eine ganz neue Form der Bildverarbeitung. Ohne die Erkenntnisse sehr renommierter Kollegen wäre das nicht möglich gewesen.

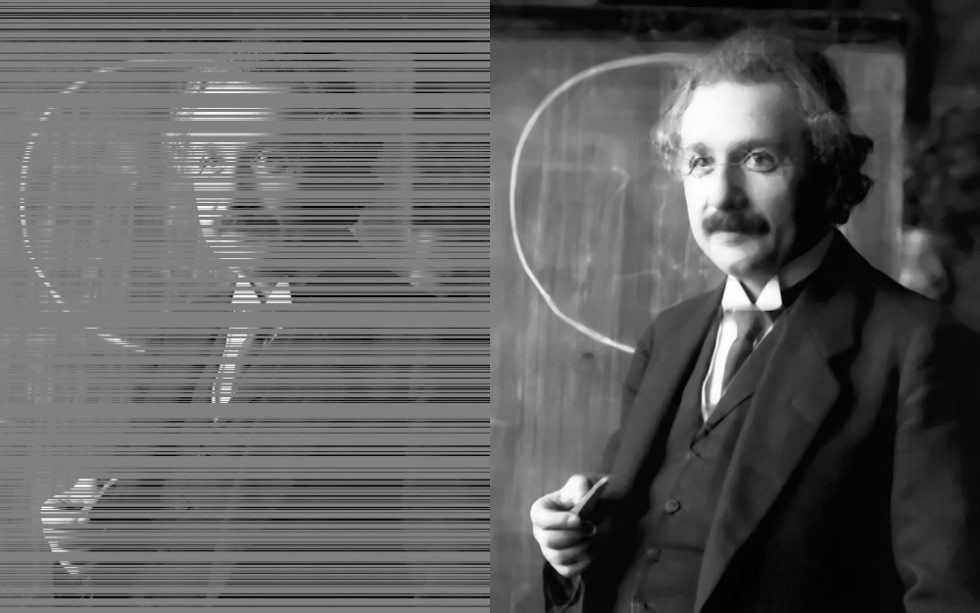

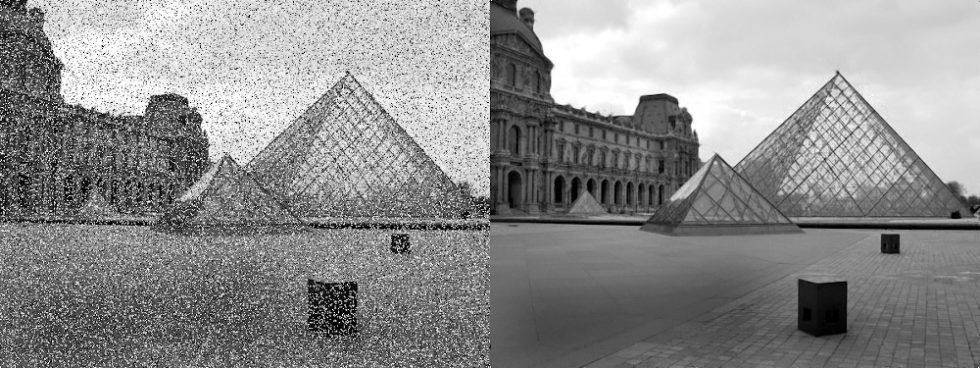

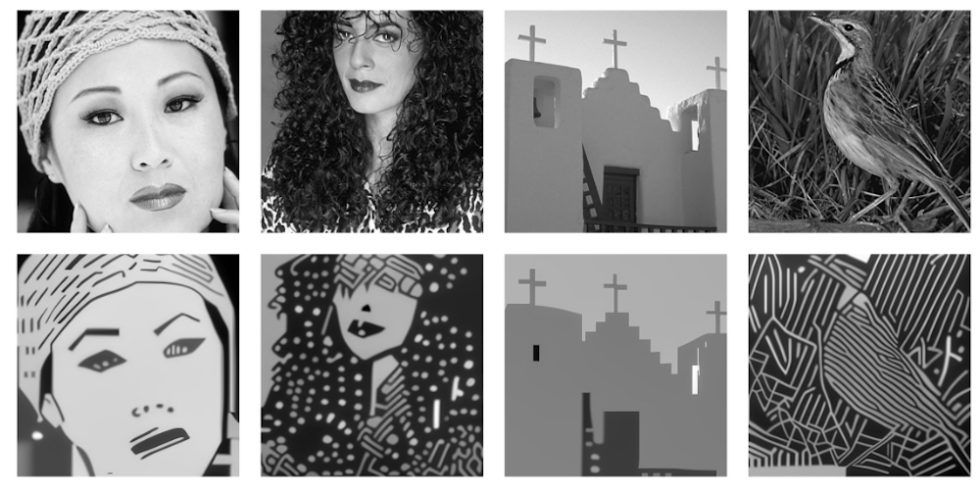

So verändert der Algorithmus die Bilder.

Foto: Pock, TU Graz / ICG

Für uns ist es selbstverständlich, dass wir etwas sehen – im Alltag macht sich wohl keiner Gedanken darüber, was für hochkomplexe Vorgänge im Gehirn ablaufen müssen, damit das möglich ist. Genau genommen ist es der Wissenschaft bis heute nicht gelungen, im Detail zu entschlüsseln, wie die Informationsverarbeitung in unseren Köpfen abläuft. Fest steht: Der sogenannte visuelle Cortex ist der Bereich im Gehirn, der dafür sorgt, dass wir in Höchstgeschwindigkeit unsere Umgebung erkennen können. Forscher der TU Graz haben jetzt alle Informationen gesammelt, die über das menschliche Sehen bekannt sind – und sie als Grundlage für eine neue Generation der Bildverarbeitung genutzt. Sie wollen der künstlichen Intelligenz (KI) das Sehen beibringen und sind dabei schon einen guten Schritt vorangekommen.

Künstliche Intelligenz soll sich am Gehirn orientieren

Es ist schon faszinierend, dass das Gehirn offensichtlich besser und schneller arbeitet als ein Hochleistungscomputer. Das wird beim Sehen besonders deutlich. Denn der visuelle Cortex ist in der Lage, Bilder zu erfassen, auch wenn er sie nur extrem kurz sieht. Zudem erkennt er Objekt, von denen er nur einen Teilbereich wahrnimmt. Dabei passieren zwar durchaus Fehler, es sind aber erstaunlich wenige. Das hängt mit dem speziellen Aufbau des visuellen Cortex zusammen. Vereinfacht gesagt, werden die eingehenden Informationen mit bekanntem Wissen abgeglichen. Zusammenhänge und vertraute Muster dienen dazu, die neuen Informationen einzuordnen und gegebenenfalls zu ergänzen.

Die Idee, diese Aufgabe einer künstlichen Intelligenz beizubringen, ist natürlich nicht neu. Entsprechend programmierte Deep-Learning-Algorithmen schneiden bei Mustererkennungsaufgaben zum Teil hervorragend ab. Hier entsteht aber eine ähnliche Problematik wie beim Gehirn selbst: Die Arbeitsstruktur liegt nicht offen. Die Forscher können also nicht nachvollziehen, wie genau die Algorithmen die Informationen verarbeiten – und wann sie welche Fehler machen.

Künstliche Intelligenz, kombiniert mit gut erforschtem Wissen

Thomas Pock vom Institut für Maschinelles Sehen und Darstellen der TU Graz ist daher mit seiner Arbeitsgruppe einen anderen Weg gegangen. Im Rahmen seines ERC-Starting-Grant-Projekts HOMOVIS (High Level Prior Models for Computer Vision) haben er und seine Kollegen die bekannte Arbeitsweise des visuellen Cortex über mathematische Modelle abgebildet und Anwendungen zur Bildverarbeitung damit gefüttert.

Für die Grundlagen der künstlichen Intelligenz griff Pock auf die Arbeit früherer Kollegen zurück: Max Wertheimer ist einer der wichtigsten Begründer der Gestaltpsychologie und hat mit seinen Theorien nach Ansätzen gesucht, wie Reize und Sinneseindrücke im Gehirn zu einem großen Ganzen zusammensetzt werden. „Der Mensch kann schon anhand einzelner Punkte oder subjektiver Konturen (Scheinkonturen) lückenhafte beziehungsweise unvollständige Objekte korrekt erkennen. Das menschliche Gehirn ergänzt die fehlende Bildinformation automatisch. Beispielsweise, indem es die Punkte über möglichst glatte Kurven miteinander verbindet“, erklärt Pock. Dieses Prinzip haben er und sein Team mit mathematischen Modellen beschrieben, die auf Euler’s Elastica beruhen. Mit dieser Gleichung des Mathematikers Leonhard Euler können Kurven anhand minimalster Krümmung berechnet werden.

Auf Basis dieser Formel entwickelten die Wissenschaftler Algorithmen für krümmungsabhängige Bildverarbeitungsprobleme. Dabei stellte sich heraus: Die Lösung ist leichter, wenn die (2D-)Bilder und deren Merkmale als Datenpunkte in einem dreidimensionalen Raum dargestellt werden. „In der dritten Dimension bekommen wir mit der Orientierung der Objektkanten eine zusätzliche Variable“, erklärt Pock. Auch diese Vorgehensweise der künstlichen Intelligenz gleicht dem menschlichen Sehen und zieht die Arbeiten der beiden Nobelpreisträger David Hubel und Torsten Wiesel heran. Sie hatten schon 1959 festgestellt, dass der visuelle Cortex aus orientierungssensitiven Schichten aufgebaut ist.

Erfolgreiche Tests mit medizinischen Verfahren zur Bildgebung

Im nächsten Schritt wollen die Forscher die bekannten strukturellen Eigenschaften des visuellen Cortex mit Deep-Learning-Algorithmen kombinieren. Ihr Ziel sind Modelle, die genauso gut funktionieren wie derzeitige Deep-Learning-Algorithmen, aber verbunden mit einem Verständnis über die gelernten Strukturen. Unter anderem ließen sich so mögliche Fehlerquellen leichter finden.

Testweise haben die Wissenschaftler bereits Computertomografien (CT) und Magnetresonanzbilder (MRT) rekonstruiert. „Mit den neu entwickelten Algorithmen lassen sich nun trotz weniger aufgenommener Daten Bilder mit höchster Qualität rekonstruieren. Das spart Zeit und Rechenleistung und somit auch Kosten“, erklärt Pock. Die künstliche Intelligenz hat ihren Nutzen also bereits bewiesen.

Das kann künstliche Intelligenz:

Ein Beitrag von: