Virtuelle Realität jetzt auch haptisch besser erleben

Im Rahmen seiner Doktorarbeit an der Universität des Saarlandes entwickelte der Informatiker André Zenner zwei neue VR-Controller. Mit ihnen ist es nun möglich, die virtuelle Realität auch haptisch besser zu nutzen. Dafür setzte er neben den neuen Controllern auch auf einen Eye-Tracker mit dazu passendem Algorithmus.

Zwei Flamenco-Fächer sorgen dafür, dass der Controller mit Namen "Drag:on" einen größeren Luftwiderstand entwickelt.

Foto: Oliver Dietze – DFKI

Bei der Virtuellen Realität (VR) geht es um eine vom Computer generierte, also künstliche Wirklichkeit. Die aufwendigen 3D-Bilder lassen auch Interaktionen zum Beispiel in Form körperlicher Bewegungen zu. Das kann über spezielle Eingabegeräte funktionieren, zum Beispiel einer Video- oder VR-Brille oder auch einem Datenhandschuh. VR wird dank spezieller Hard- und Software erlebbar. Viele Branchen beschäftigen sich mit dem Einsatz von VR, in der Wissenschaft geht es vor allem darum, sie noch weiterzuentwickeln.

Augmented Reality für Einsteiger – so lässt sie sich sinnvoll nutzen

André Zenner, Informatiker an der Universität des Saarlandes, hat sich im Rahmen seiner Doktorarbeit damit beschäftigt, wie VR auch haptisch erfahrbar wird. Seine Idee: sogenannte physische Requisiten einsetzen. Fachleute sprechen in dem Fall auch von „Proxys“. Gegenstand der Arbeit war konkret, wie solche Geräte aussehen können. Denn wichtig ist in diesem Zusammenhang vor allem, dass die physischen Eigenschaften nicht nur von verschiedenen virtuellen Objekten, sondern auch möglichst effektiv simuliert werden können.

VR: Zwei neue Controller eröffnen neue Dimension

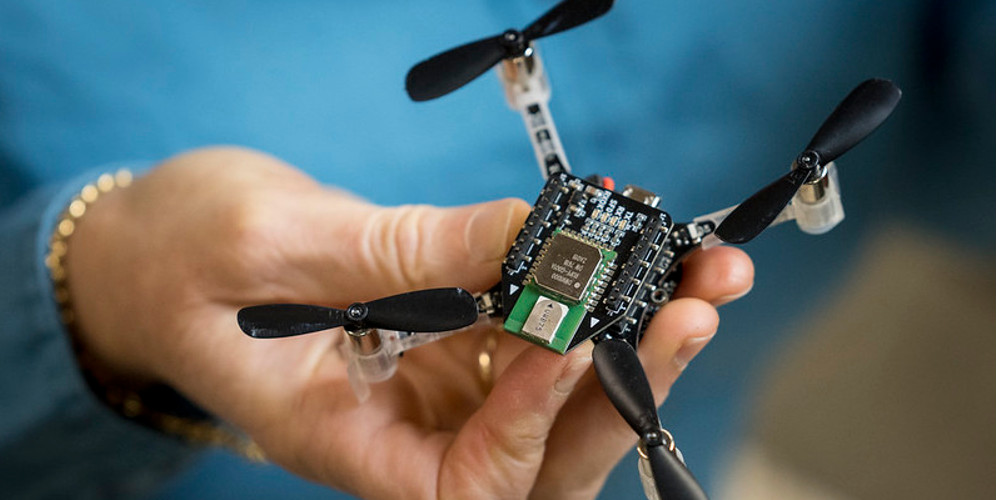

Zenner, der auch am Deutschen Forschungszentrum für Künstliche Intelligenz forscht, hat im Rahmen seiner Dissertation zwei besondere VR-Controller entwickelt. Sie tragen die Namen „Shifty“ und „Drag:on“. VR-Controller an sich sind nichts neues. Sie werden von Hand bedient und mit ihrer Hilfe lassen sich Objekte in der Virtuellen Realität steuern oder auch manipulieren. Die beiden von Zenner entwickelten Controller haben jedoch besondere Funktionen, die es so zuvor noch nicht gab.

Wer „Shifty“ nutzt, der bekommt den Eindruck, dass ein virtuelles Objekt länger oder schwerer wird. Denn der stabförmige Controller beinhaltet ein bewegliches Gewicht. Das lässt sich mittels eines Motors entlang der Längsachse verschieben. Auf diese Art und Weise verändert sich der Schwerpunkt sowie die Trägheit des Stabes, was eben den Eindruck erweckt, ein Objekt wird länger oder schwerer. Der Forscher hat sich eingehend damit beschäftigt und im Vorfeld eine Reihe von Tests durchgeführt. Dabei kam heraus, dass die Testpersonen Objekte als leichter oder kleiner empfinden, wenn das Gewicht eher in der Nähe der Hand der Testperson ist. Je weiter sich das Gewicht im Stab von der Testperson entfernt, desto länger und schwerer wird es empfunden. „Das hängt vor allem mit Veränderungen der Trägheit des Controllers zusammen, denn das Gesamtgewicht ändert sich ja nicht“, erklärt Zenner.

Damit sich virtuelle und echte Objekte ähnlich anfühlen

„Drag:on“ heißt der zweite von André Zenner entwickelte Controller. Er besteht aus zwei Flamenco-Fächern. Ein Servomotor ist in der Lage diese aufzufalten. Dadurch erhöht sich der Luftwiderstand des Controllers. Je mehr die Fächer aufgefaltet sind, desto mehr Kraft musste die Testperson aufwenden, wenn sie den Controller in der Luft bewegen wollte. „Gepaart mit den richtigen visuellen Reizen kann mit Drag:on beispielsweise der Eindruck erzeugt werden, dass man gerade eine kleine Schaufel oder ein großes Paddel in der Hand hält oder dass man einen schweren Wagen schiebt und an einem schwergängigen Knopf dreht“, sagt der Forscher. Bei beiden Controllern handelt es sich aktuell noch um Prototypen, auf dem Markt erhältlich sind sie dementsprechend also noch nicht. Allerdings sei schon die Forschungs- und Entwicklungsabteilung von Sony auf die neuen Ergebnisse aufmerksam geworden.

André Zenner hat sich mit seinen neu entwickelten Controllern vor allem einer Forschungsfrage gewidmet: Wie ist es möglich, dass sich virtuelle und echte Objekte möglichst ähnlich anfühlen? Fachleute nennen es das Ähnlichkeitsproblem (similarity problem). Darüber hinaus war aber auch das sogenannte „colocation problem“ Gegenstand seiner Arbeit. In diesem Fall geht es um die Frage, ob sich das Proxy räumlich auch in der Realität dort befindet, wo der Nutzer es in der virtuellen Realität wahrnimmt. Vor allem dieses Problem ist nicht einfach zu lösen, denn die Controller dienen für verschiedene virtuelle Objekte als Proxy. Dementsprechend fasst ein Nutzer in der Realität immer ein und dasselbe Proxy, in der virtuellen Realität sind es aber unterschiedliche Objekte, nach denen man greift.

Gehirn austricksen und VR noch intensiver erleben

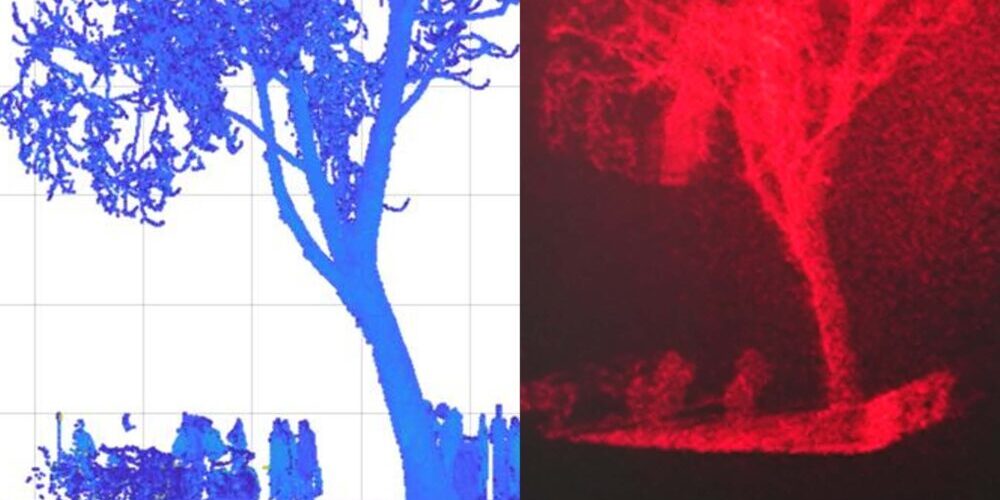

Lösen konnte der Forscher aus Saarbrücken das Problem einerseits mit der bekannten Methode der „Hand Direction“, also der Umlenkung der Handbewegung in der virtuellen Realität, und andererseits musste er das Gehirn etwas austricksen. Während der Nutzer meint, nach links zu greifen, wird die Hand aber gerade nach vorn ausgestreckt. Diese Umlenkung funktioniert nur dann, wenn das Gehirn für ganz kurze Zeit praktisch blind ist für visuelle Veränderungen – zum Beispiel, wenn wir blinzeln. Das gelang ihm durch den Einsatz eines neuen VR-Headsets, in das ein besonderer Eye-Tracker eingebaut wurde. Mit der passenden Software zeigten die Tests, dass die Testpersonen mithilfe der neuen Controller in Kombination mit Handumlenkungs-Algorithmen die virtuelle Realität überzeugender wahrnahmen.

Ein Beitrag von: