Fraunhofer: Wie vertrauenswürdig sind KI-Systeme?

Künstliche Intelligenz (KI) birgt enormes Potenzial für die Industrie. Viele Unternehmen fragen sich jedoch, wie leistungsfähig und sicher KI-Systeme sind. Auf der Hannover Messe präsentiert das Fraunhofer IAIS zwei Exponate und konkrete Anwendungsbeispiele, die zeigen, welche Lösungen KI bereithält und wann besser der Mensch entscheidet.

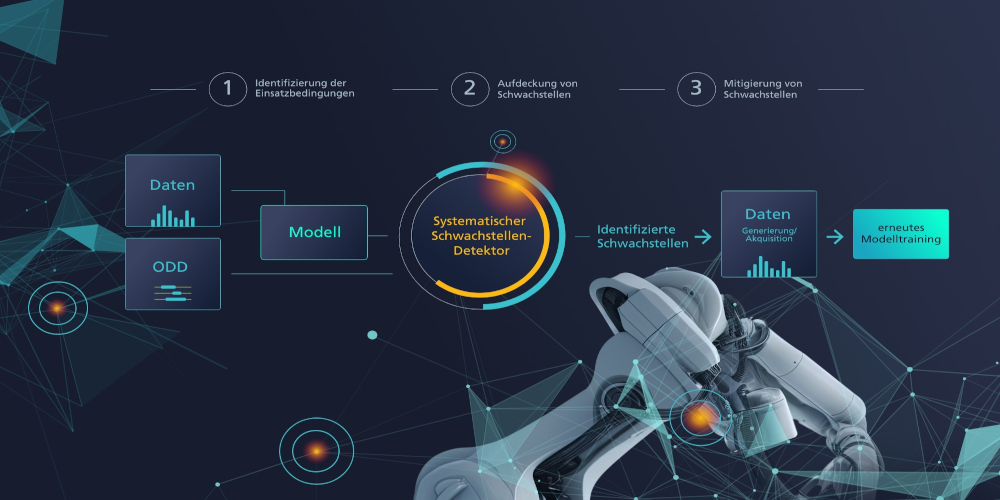

Ein systematisches Vorgehen in Kombination mit KI-Prüftools hilft dabei, Schwächen von KI-Modellen ausfindig zu machen.

Foto: Fraunhofer IAIS / Zertifizierte KI

Systeme, die auf künstlicher Intelligenz (KI) basieren, sind in der Lage, große Datenmengen zu analysieren und komplexe Muster oder Trends zu erkennen. Darüber hinaus ermöglichen KI-Systeme die Automatisierung von zeitaufwändigen Aufgaben und steigern damit die Effizienz der Produktion. Nicht zuletzt können KI-Systeme Fehler oder Abweichungen in Produktionsprozessen erkennen und frühzeitig melden, um die Qualität von Produkten zu verbessern und den Ausschuss zu reduzieren. Kurz: Mithilfe künstlicher Intelligenz können Unternehmen ihre Betriebsabläufe optimieren und sich besser an die sich verändernden Anforderungen des Marktes anpassen.

Doch die neuen Anwendungsfelder von KI werfen auch Fragen auf: Wie zuverlässig sind KI-Systeme? Wie lassen sich Schwachstellen von KI-Systemen aufdecken und wie sicher sind sie? Mit diesen Fragen befassen sich Forschende des Fraunhofer-Instituts für Intelligente Analyse- und Informationssysteme (IAIS) und der Institute der Fraunhofer-Allianz Big Data (AI). Auf der Hannover Messe 2024 präsentieren sie zwei Exponate und mehrere Anwendungsbeispiele zum Thema vertrauenswürdige KI-Lösungen.

Sora von OpenAI – so mächtig ist die generative Text-to-Video-KI

Exponat 1: Zuverlässigkeit von KI-Modellen testen

Bei dem ersten Exponat handelt es sich um ein Prüftool, welches das KI-System systematisch auf Schwachstellen hin überprüft, um so seine Zuverlässigkeit sicherzustellen. „Unsere Methodik beruht darauf, den Anwendungsbereich des KI-Systems genau zu spezifizieren. Konkret geht es darum, den Raum der möglichen Eingaben, die das KI-System verarbeitet, zu parametrisieren und mit einer semantischen Struktur zu versehen. Mit den KI-Prüfwerkzeugen, die wir unter anderem im KI.NRW-Flagships-Projekt ›Zertifizierte KI‹ entwickelt haben, lassen sich dann Fehler der KI-Systeme erkennen“, erklärt Maximilian Poretschkin vom Fraunhofer IAIS.

Exponat 2: Vertrauenswürdigkeit von KI-Modellen erleben

Das zweite Exponat ist als interaktives Spiel gestaltet. Hier können Besucherinnen und Besucher der Hannover Messe 2024 selbst erleben, ob und wie weit künstliche Intelligenz die eigene Entscheidungsfreiheit beeinflusst und wie vertrauenswürdig KI-basierte Systeme tatsächlich sind. Dabei fordert das interaktive Spiel Entscheidungen ein: In welchen Anwendungsgebieten sind KI-Systeme dem Menschen überlegen und welche Entscheidungen sollte der Mensch doch besser selbst treffen?

„Das Spiel macht für jeden erlebbar, wo KI ein hilfreicher Assistent sein kann und wo der Mensch besser mitentscheidet. Ziel ist immer, zur richtigen Entscheidung zu kommen, ohne dass der Mensch seine Entscheidungskompetenz und Souveränität verliert“, sagt Sebastian Schmidt vom Fraunhofer IAIS.

Anwendungsbeispiele von KI-Systemen

Neben dem Prüfungstool zum systematischen Testen von KI-Modellen und dem interaktiven Spiel, das die Vertrauenswürdigkeit von KI hinterfragt, präsentieren die Fraunhofer-Institute auf der Hannover Messe 2024 mehrere Anwendungsbeispiele. Sie zeigen, wie sich KI sicher und kontrolliert einsetzen lässt:

KI-Anwendung DigiWeld schützt sensible Daten

Das Fraunhofer IPA hat eine Lösung entwickelt, mit der Maschinen- und Anlagenbauer die Vorteile künstlicher Intelligenz nutzen können, ohne dabei sensible Produktionsdaten ihrer Kunden zu erfassen.

KI-Anwendung DisCo erkennt Fake News

Das Fraunhofer-Institut für Sichere Informationstechnologie SIT erprobt textforensische Methoden, um Journalisten bei der Identifizierung potenzieller Fake News zu unterstützen. Prüfwürdige Textpassagen werden farblich hervorgehoben.

KI-Anwendung OpenGPT-X trainiert Sprachmodelle

Das Konsortialprojekt OpenGPT-X zielt darauf ab, große KI-Sprachmodelle mit bis zu 24 europäischen Sprachen zu trainieren. Diese sollen Unternehmen als Open Source zur Verfügung stehen, um generative KI-Anwendungen zu entwickeln und Prozesse zu optimieren.

Uncertainty Wrapper sorgt für Sicherheit im Straßenverkehr

Der Uncertainty Wrapper des Fraunhofer-Instituts für Experimentelles Software Engineering IESE untersucht, wie zuverlässig KI-Vorhersagen sind, insbesondere im Bereich der Objekterkennung von Straßenschildern.

Diese Lösungen für konkrete Anwendungsbeispiele tragen dazu bei, den Einsatz von KI-Modellen verantwortungsvoll zu gestalten, um Sicherheit, Transparenz und Datenschutz zu gewährleiten. Nur so lässt sich das volle Potenzial von künstlicher Intelligenz ausschöpfen, darin sind sich die Forschenden einig. „Viele Technologien und Lösungen kommen aktuell nicht aus Europa. Die Forschung der Fraunhofer-Gesellschaft trägt dazu bei, die technologische Souveränität und Unabhängigkeit deutscher Unternehmen zu erhalten und auszubauen“, sagt Dr. Sonja Holl-Supra, von der Fraunhofer-Allianz Big Data AI.

Die Hannover Messe 2024 findet von 22.04 bis zum 26.04.2024 statt. In dieser Zeit können sich Interessierte am Fraunhofer Stand (Halle 2, Stand B24) anhand der Exponate über Anwendungsbeispiele und Lösungen für vertrauenswürdige KI informieren.

Ein Beitrag von: