KI-Bildbearbeitung: Macht DragGAN bald Photoshop Konkurrenz?

Künstliche Intelligenz erobert derzeit unsere Welt wie im Flug, auch in Sachen Bildbearbeitung sind enorme Fortschritte zu beobachten. Gerade wurde mit DragGAN ein Tool vorgestellt, dass die Nachbearbeitung von Fotos auf ein ganz neues Level heben könnte und das dazu noch ganz einfach zu bedienen ist.

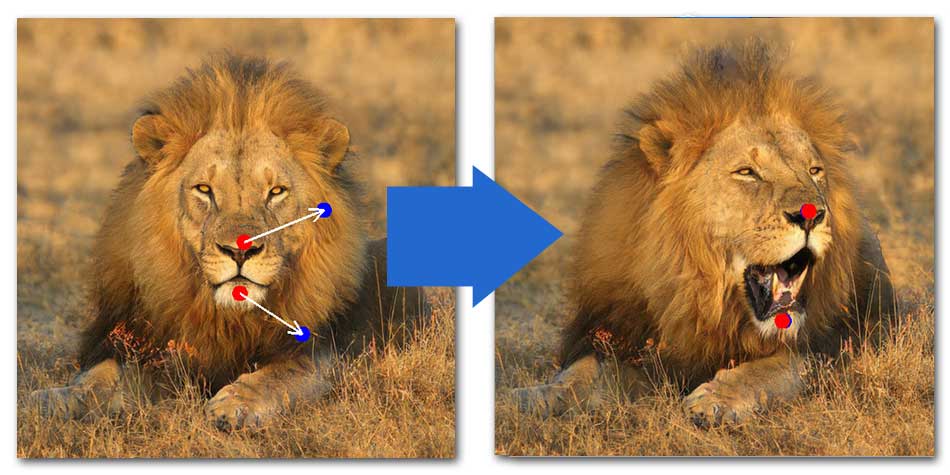

DragGAN ermöglicht ein Ändern der Blickrichtung oder des Gesichtsausdrucks ganz einfach per Drag & Drop.

Foto: MPI-INF

Adobe Photoshop ist bislang das Maß aller Dinge, wenn es um die Bildbearbeitung geht. Allerdings kann die Nutzung von Photoshop für viele Benutzerinnen und Benutzer recht komplex sein. Das soll bei DragGAN anders sein. Die Software wurde von einem internationalen Forschungsteam unter der Leitung des Saarbrücker Max-Planck-Instituts für Informatik entwickelt. Durch den Einsatz von maschinellem Lernen eröffnet DragGAN völlig neue Möglichkeiten für die Bildbearbeitung. Diese Technologie verspricht eine benutzerfreundliche Anwendung und ermöglicht es Anwendern, ihre Fotos auf eine bisher unerreichte Weise zu bearbeiten.

Bildbearbeitung per Drag & Drop

Dank der Fortschritte in der künstlichen Intelligenz lassen sich mit Tools wie Dall-E, Midjourney und Stable Diffusion heute selbst die absurdesten Bildideen umsetzen. Früher musste man solche Ideen mühsam in Photoshop zusammenbasteln, doch nun erledigen diese Tools diese Aufgaben in Sekundenschnelle. Auch im Bereich der Bildbearbeitung haben KI-Algorithmen bereits seit einiger Zeit einen wertvollen Beitrag geleistet. Allerdings stoßen sie immer noch an gewisse Grenzen, insbesondere wenn es darum geht, ein fotografiertes Objekt aus einer völlig anderen Perspektive zu präsentieren oder einen Gesichtsausdruck zu verändern.

Zukünftig wird es wahrscheimlich möglich sein, komplexe Bildbearbeitungsaufgaben mithilfe einer einfachen Drag & Drop-Funktion und ein paar Mausbewegungen zu erledigen. Dies ist zumindest das vielversprechende Vorhaben von Wissenschaftlerinnen und Wissenschaftlern des Max-Planck-Instituts für Informatik, des Saarbrücken Research Center for Visual Computing, Interaction and Artificial Intelligence, des MIT und der Universität Pennsylvania. Durch ihre Forschung und Entwicklung arbeiten sie daran, eine benutzerfreundliche Lösung zu schaffen, die es Anwendern ermöglicht, Bilder auf intuitive und zeitsparende Weise zu bearbeiten.

Verschiedene Bildbearbeitungen, die mithilfe der Methode DragGAN durchgeführt wurden.

Foto: MPI-INF

Neue Methode hat das Zeug, die digitale Bildbearbeitung für immer zu verändern

„Mit ‚DragGAN‘ entwickeln wir derzeit ein Werkzeug, dass es dank einer übersichtlichen Nutzeroberfläche auch Laien ermöglicht, komplexe Bildbearbeitungen vorzunehmen. Sie müssen nur die Stellen im Foto markieren, die sie verändern möchten. Dann geben sie in einem Menü an, welcher Art die Veränderung sein soll – und mit nur wenigen Mausklicks kann jeder Laie dank KI-Unterstützung die Pose, den Gesichtsausdruck, die Blickrichtung oder den Blickwinkel auf einem Foto, beispielsweise von einem Haustier, anpassen“, erklärt Christian Theobalt, geschäftsführender Direktor des Max-Planck-Instituts für Informatik, Direktor des Saarbrücken Research Center for Visual Computing, Interaction, and Artifical Intelligence und Professor an der Universität des Saarlandes am Saarland Informatics Campus.

Möglich wird das alles durch Künstliche Intelligenz, genauer gesagt durch GANs, das steht für „Generative Adversarial Networks“. „Wie der Name sagt, handelt es sich bei GANs um generative Modelle, also solche, die neue Inhalte wie Bilder synthetisieren können. ‚Adversarial‘ zeigt an, dass es sich um ein KI-Modell handelt, in dem zwei Netzwerke gegeneinander spielen“, erklärt der Erstautor des Papers, Xingang Pan, Postdoktorand am Max-Planck-Institut für Informatik und am Saarbrücker VIA-Center.

Wie funktionierten GANs?

GANs bestehen aus einem Generator, der Bilder erzeugt, und einem Discriminator, der entscheidet, ob die Bilder vom Generator oder echt sind. Dieses System wird trainiert, bis der Discriminator keine Unterscheidung mehr treffen kann.

Die Anwendungsmöglichkeiten sind vielfältig: Neben der offensichtlichen Verwendung des Generators zur Bildgenerierung sind GANs auch gut darin, Bilder vorherzusagen. Ein Beispiel dafür ist die Video-Frame-Prediction, bei der das nächste Bild eines Videos prognostiziert wird, um den Datenbedarf beim Videostreaming zu reduzieren. Darüber hinaus können GANs niedrig aufgelöste Bilder hochskalieren und die Bildqualität verbessern, indem sie die Position der zusätzlichen Pixel in den neuen Bildern vorhersagen. Dies ermöglicht eine Verbesserung der Bildschärfe und Details.

„In unserem Fall erweist sich diese Eigenschaft von GANs als vorteilhaft, wenn in einem Bild zum Beispiel die Blickrichtung eines Hundes geändert werden soll. Das GAN berechnet dann im Grunde das ganze Bild neu und antizipiert, wo welches Pixel im Bild mit der neuen Blickrichtung landen muss. Ein Nebeneffekt davon ist, dass DragGAN auch Dinge berechnen kann, die vorher etwa durch die Kopfposition des Hundes verdeckt waren. Oder wenn der Nutzer die Zähne des Hundes darstellen will, kann er dem Hund auf dem Bild die Schnauze öffnen“, erklärt Xingang Pan.

Einsatz im privaten und professionellen Kontext

Mit DragGAN lassen sich nicht nur private Schnappschüsse nachbearbeiten, es könnte auch im professionellen Kontext genutzt werden. Modedesigner könnten in Zukunft mit der Software den Zuschnitt von Kleidungsstücken auf Fotos nachträglich anpassen. Ebenso könnten Fahrzeughersteller mithilfe weniger Mausklicks verschiedene Design-Konfigurationen für geplante Fahrzeuge ausprobieren.

DragGAN ist in der Lage, verschiedene Objektkategorien wie Tiere, Autos, Menschen und Landschaften zu bearbeiten. Bisher wurden die meisten Ergebnisse jedoch mit GAN-generierten, synthetischen Bildern erzielt. Es besteht jedoch das Potenzial, DragGAN auf reale Fotos auszudehnen und somit eine breitere Anwendungspalette zu ermöglichen.

Ist das der nächste große Schritt in der KI-gestützten Bildbearbeitung?

Das kürzlich von den Saarbrücker Informatikern entwickelte Tool hat innerhalb weniger Tage nach Veröffentlichung des Preprints in der internationalen Tech-Community viel Aufmerksamkeit erregt. Es wird von vielen als der nächste große Schritt in der KI-gestützten Bildbearbeitung angesehen. Während Tools wie Midjourney dazu dienen, neue Bilder zu erstellen, erleichtert DragGAN die Nachbearbeitung von Bildern erheblich.

Die Autoren des Papers mit dem Titel „Drag Your GAN: Interactive Pointbased Manipulation on the Generative Image Manifold“ sind neben Professor Christian Theobalt und Xingang Pan auch Thomas Leimkühler (MPI INF), Lingjie Liu (MPI INF und University of Pennsylvania), Abhimitra Meka (Google) und Ayush Tewari (MIT CSAIL). Das Paper wurde von der ACM SIGGRAPH-Konferenz akzeptiert, der weltweit größten Fachkonferenz für Computergrafik und interaktive Technologien, die vom 6. bis 10. August 2023 in Los Angeles stattfinden wird. Dadurch erhält das Projekt eine wertvolle Plattform, um die Ergebnisse der Forschung einem breiten Fachpublikum zu präsentieren.

Ein Beitrag von: